在基于功能近红外光谱(fNIRS)的脑-机接口(BCI)领域中,传统的受试特定解码方法存在校准时间长和跨受试泛化性低等问题,从而限制了BCI系统在日常生活和临床领域中的推广和应用。为解决上述困境,本文提出了一种新颖的深度迁移学习方法,该方法联合了改进型启发式残差网络(rIRN)模型和基于模型的迁移学习(TL)策略,简称TL-rIRN。本文开展了跨受试识别心算和心唱任务的试验,以验证TL-rIRN方法的有效性和优越性。结果表明,相较于受试特定解码方法和其他深度迁移学习方法,TL-rIRN方法显著缩短了校准时间,减少了目标模型的训练时间和计算资源的消耗,并增强了跨受试解码性能。综上,本研究为fNIRS-BCI系统的跨受试、跨任务以及实时解码算法的选择提供了依据,在构建便捷通用型BCI系统方面具有潜在应用价值。

引用本文: 张耀, 刘东远, 高峰. 基于功能近红外光谱的跨受试心理任务识别的深度迁移学习方法. 生物医学工程学杂志, 2024, 41(4): 673-683. doi: 10.7507/1001-5515.202310002 复制

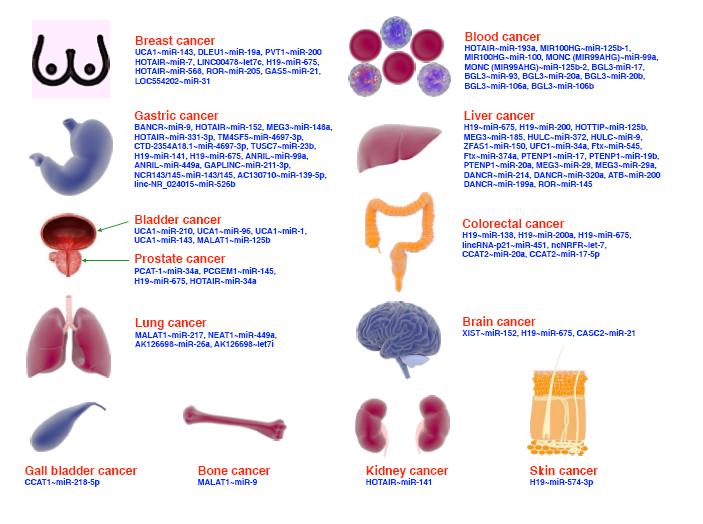

0 引言

功能近红外光谱(functional near-infrared spectroscopy,fNIRS)是一种新型无创、实时、非电离、便携、低成本、低运动伪影和主动测量式的光学神经成像技术,具有合理的时空分辨率。与脑电图(electroencephalography,EEG)相比,fNIRS具备较高的空间分辨率和较强的环境鲁棒性[1-3]。与功能磁共振成像(functional magnetic resonance imaging,fMRI)相比,fNIRS具备较高的时间分辨率、较低的环境噪声干扰和优异的运动鲁棒性[4-5]。因此,fNIRS在无创脑-机接口(brain-computer interface,BCI)领域中得到了广泛应用。目前,fNIRS-BCI主要应用于脑控机器、神经康复、疾病诊疗和教育教学等诸多领域[3, 6-7]。近年来,fNIRS-BCI技术发展迅速并取得了显著进展,但其在实际应用中仍面临着重大挑战[1-2],这是因为fNIRS信号是时变非平稳信号,通常表现为受试内特异性较高、受试间变异性较强和重测信度较低[8-9]。fNIRS信号易受用户的认知负荷、跨试次认知疲劳和学习效应等因素影响,导致其在当天试验过程中会随时间发生改变[9]。因此,在使用fNIRS-BCI系统之前,用户通常需要进行一段较长时间的校准过程,以收集足够的数据来构建一个稳定且可靠的受试特定解码算法,从而精确识别自身行为和心理状态。然而,较长的校准过程会导致用户在使用fNIRS-BCI系统前就已感到疲劳,从而显著降低了BCI系统的实用性。此外,个体差异也会影响受试特定解码算法在不同受试间的泛化性能,进而降低其在实际应用时的可靠性和普适性。

传统的受试特定解码算法存在两个固有瓶颈,即校准时间过长和跨受试泛化性低。校准时间,是指建立和优化BCI系统性能所需的数据采集和处理时间,包括收集用户的大脑活动数据,并将其与特定的任务或意图进行匹配。通过校准,系统能够学习并识别与特定意图相关的大脑信号模式,以实现用户意图的准确解码和相应操作的执行。跨受试泛化性低,是指BCI系统在处理新用户数据时识别性能下降的现象。为克服这些问题,BCI研究者提出了跨受试解码方法(即受试独立解码),该方法已成为解决上述问题的关键技术,并成功提升了BCI系统的实用性和稳定性[8, 10-12]。跨受试解码是BCI研究中一个重要的领域[12-13],其旨在从多名受试的脑信号中提取受试间神经激活的共同特征,来构建一个通用的心理状态识别算法,从而可在新受试上实现神经激活模式的精确识别。

跨受试解码方法已被广泛应用于EEG-BCI和fMRI-BCI领域[10-12, 14-17],这也将在未来成为fNIRS-BCI研究的重要方向。在fMRI-BCI领域中,Raizada等[15]从神经激活的相似性角度出发,提出了神经相似性空间方法,用于解决跨受试解码问题。随着人工智能的快速发展,全数据驱动的深度学习识别算法作为自动特征提取器和分类器,而被广泛应用于神经信号解码中[18-20]。在EEG-BCI领域中,Kwon等[10]提出了一种基于深度卷积神经网络(convolutional neural network,CNN)的无校准受试独立解码方法,用于跨受试识别左、右手运动想象的EEG信号。受上述研究启发,Kwon等[8]也将CNN模型应用于无校准跨受试解码fNIRS信号中,以跨受试识别是在执行心算(mental arithmetic,MA)任务还是处于空闲状态。Kwon等[8]的研究证明了基于CNN模型的跨受试解码方法在fNIRS-BCI中的可行性。然而,该方法通过使用多名受试者数据来构建通用的CNN解码模型,该模型只能学习到受试间神经激活的共同特征,而无法习得目标受试者的个体特征。尽管无校准跨受试解码方法提高了fNIRS-BCI系统的通用性和实用性,但跨受试解码精度的提升仍受到限制。因此,使用少量目标受试者的数据对通用模型进行微调,是提高跨受试解码精度的关键步骤[8, 21]。在最新的fNIRS-BCI研究中,Khalil等[22]将基于同构对称特征的迁移学习应用于CNN中,来识别不同水平的心理负荷。然而,该方法局限性在于,它依赖于同构性假设,并且仅适用于同构任务,即任务之间的样本分布在特征空间中是相似的。在fNIRS-BCI的实际应用中,异构任务(即不同心理任务)的样本分布差异较大。此情况下,同构对称特征迁移学习无法有效地进行跨任务识别。此外,将CNN模型应用于fNIRS-BCI也存在一定的局限性。该模型并未针对fNIRS信号的时空特性进行结构性调整和设计。由于CNN模型仅使用小尺寸的滤波器提取局部特征,因此难以有效捕捉到大范围、多尺度和高阶的特征[14, 23-25]。

本研究致力于解决上述跨受试解码fNIRS信号所面临的挑战,旨在以最少量的校准数据最大程度地提升跨受试解码心理任务的准确率。为此,本文创新性地提出了一种深度迁移学习方法,以增强跨受试解码的性能。该方法融合了改进型启发式残差网络(revised inception-residual network,rIRN)与迁移学习(transfer learning,TL)策略,简称为TL-rIRN方法。其中,rIRN模型作为一种先进的深度学习算法,已显示出在fNIRS信号识别方面的显著优势[14];而基于模型的迁移学习策略,不仅适用于同构任务,更能有效应对跨任务解码的挑战。为了全面验证TL-rIRN方法在跨受试解码中的可行性和优越性,本研究将其与未经微调的预训练模型以及其他深度迁移学习方法进行深入对比分析。期望通过本文研究,提出的TL-rIRN方法能为fNIRS-BCI领域的跨受试解码研究提供全新的视角和解决方案。

1 方法

1.1 改进型启发式残差网络模型

rIRN模型是在启发式残差网络(inception-residual network,IRN)架构的基础上,针对fNIRS信号的复杂时空特性做了精心的结构性设计和调整,旨在精确识别大脑在不同任务下的激活状态[14]。该模型的整体架构如图1所示,详尽地展示了卷积滤波器的关键参数设置,包括滤波器数量(number of filters,NF)、滤波器尺寸(filter size,FS)以及卷积操作的步长(stride)。rIRN模型的输入层是多变量时间序列表示的fNIRS信号,即采样点数×采样通道数。

图1

rIRN模型的架构

Figure1.

The architecture of the rIRN model

图1

rIRN模型的架构

Figure1.

The architecture of the rIRN model

rIRN模型的架构主要由空间特征提取模块(feature extraction module,FEM)和时间FEM串联组成。其中,空间FEM由空间FEM-A和空间FEM-B两个子模块组成,而时间FEM则由时间FEM-A、时间FEM-B以及时间FEM-C三个子模块组成。每个FEM子模块均由IRN网络和降维网络构成。IRN网络采用不同尺寸的一维卷积滤波器(one-dimensional convolution filter,Conv),以提取fNIRS信号中不同尺度的时空特征,进而实现增强模型的特征表示能力。多尺度时空特征提取能在更大的范围内识别出重要模式和关联;还能捕捉稳定特征,增强研究结果的鲁棒性;并适应个体大脑结构与功能差异,从而精确揭示个体独特的大脑活动模式。同时,IRN网络中的残差连接不仅有助于提取全局特征,还能有效解决深度神经网络中梯度消失或梯度爆炸问题。

每个IRN网络后都配备了一个降维网络,旨在减少模型的计算量和参数量。全局最大池化层的应用则进一步对提取的时空特征进行降维,减少了特征数量,并有助于降低模型复杂度,提高泛化能力。为了防止过拟合,在rIRN模型的末端加入了一个随机失活层。经过随机失活层处理后的特征将被输送至全连接层(full connected layer,FCL),并最终输出至分类层,以对fNIRS信号进行类别预测。分类层采用归一化指数(softmax)函数实现分类概率的输出。该模型是一种普适性的多任务识别算法,可根据fNIRS信号的特点,自适应调整时空FS的大小,以提取多尺度的特征。

1.2 深度迁移学习

深度学习模型需要大量标注数据进行训练,因此在fNIRS信号中需要较长的校准时间,以收集足够的训练数据。获取大规模标注的fNIRS数据需耗费大量时间和资源,长时间的校准会导致受试者疲劳,从而影响数据质量。为在小样本数据集上训练深度学习模型,以实现跨受试解码心理任务,本文提出了一种新颖的深度迁移学习方法—TL-rIRN,其架构如图2所示。TL-rIRN方法主要包括两个步骤:预训练和微调。首先,使用多名受试者的数据(源域数据集)对rIRN模型进行预训练。随后,将预训练的rIRN模型迁移到目标受试者的数据(目标域数据集)中,并利用目标受试者的少量数据对预训练的rIRN模型进行微调。最终,得到适用于目标受试者的微调迁移模型,用于解码目标受试者的心理状态。

图2

TL-rIRN模型的架构

Figure2.

The architecture of the TL-rIRN model

图2

TL-rIRN模型的架构

Figure2.

The architecture of the TL-rIRN model

1.2.1 预训练

在图像识别领域,已有一些在图像网络(image network,ImageNet)数据集上预训练好的网络模型,如残差网络18(residual network 18,ResNet-18)和视觉几何组16(visual geometry group 16,VGG-16)等[26]。然而,在fNIRS-BCI领域,目前尚未存在可供直接迁移使用且基于大规模数据集预训练的模型。鉴于fNIRS信号具有空间特异性和记录参数的多样性,本研究需要收集充足的心理任务数据,以从头开始预训练rIRN模型。本文采用留一受试交叉验证(leave-one-subject-out cross validation,LOSO-CV)方法来评估TL-rIRN模型在fNIRS-BCI中跨受试解码的性能[27]。本文假设已采集了n名受试者的数据,并使用LOSO-CV方法进行交叉验证。在每次交叉验证中,本文将1名受试者的数据用于微调迁移模型的训练、验证和测试,而另外的n–1名受试者的数据则用于rIRN模型的预训练。然后本文重复这个过程,直到每名受试者的数据都被用作微调迁移模型的测试。预训练模型的超参数设置如下:批量大小为8;最大的迭代轮次(epoch,Epo)[以符号max(Epo)表示]为100;初始学习率为0.01;学习率衰减系数为0.1;学习率衰减周期为20个Epo;L2正则化因子为0.000 1;梯度下降优化算法为自适应矩估计算法。

1.2.2 微调

微调,通常指的是利用目标域数据集中有限的样本,对预训练的rIRN模型的浅层网络参数进行精细调整,并对替换的新层(如最后的FCL层和分类层)进行参数重新训练的过程。这一技术旨在提高模型对特定目标域数据集的适应性和性能。微调的理论基础主要建立在神经网络的迁移学习能力之上。经过迁移学习和微调后的模型,本文称之为微调迁移模型。该模型的结构由两部分组成:一部分是共享参数的迁移层,它通过使用预训练模型的参数作为其初始参数,实现了两模型之间的参数共享;另一部分是替换的新层,这些层的参数是通过微调过程重新训练的。

超参数选择在微调过程也扮演着重要的角色。本文根据目标域数据集的特点,选择合适的优化器、学习率、批量大小等超参数。在微调迁移模型的超参数调整过程中,初始学习率被设置为0.001。此值低于预训练模型的学习率,以有效减缓迁移层的学习速度。此外,本文对替换的FCL层的权重和偏置进行了设置,将其学习率因子设为10。该值高于预训练模型中默认的学习率因子1,能够加速新的最终层的学习速度。采用上述学习率的组合能够有效提高微调迁移模型的收敛速度和精度,对于迅速适应目标受试者的数据模式大有裨益。为避免微调过程中出现过拟合问题,通常将微调迁移模型的max(Epo)设置为少于预训练模型的数值[22]。这不仅可以有效解决过拟合问题,还能缩短微调迁移模型的训练时间。同时,本文还利用目标受试者的验证集来监控模型的性能,并根据需要调整超参数以获得最佳分类性能。另外,如果微调迁移模型的验证损失函数连续20次没有持续下降,训练会停止,以避免过拟合。

TL-rIRN模型是在计算机操作系统Windows 10(Microsoft Inc.,美国)上使用商业数学软件MATLAB R2022b(MathWorks Inc.,美国)构建的。该模型是在一台服务器上进行训练和测试,该服务器的配置如下:8条内存(DDR4 2666MHz 16.00 GB,Samsung Inc.,韩国)、2颗中央处理器(Xeon Gold

1.3 评估指标

本研究将MA任务作为正类,心唱(mental singing,MS)任务作为负类,并采用6个指标来定量评估所提TL-rIRN方法在跨受试解码中的分类性能。这些指标包括准确率(accuracy,Acc)、精确度(precision,Pre)、召回率(recall,Rec)、F1分数、卡帕系数(Kappa,Kap)以及曲线下面积(area under the curve,AUC)值。前5个指标均是通过混淆矩阵计算而来,其表达式如式(1)所示:

|

式中,真阳性(true positive,TP)表示被正确分类为正类的样本数;假阳性(false positive,FP)表示被错误分类为正类的样本数;真阴性(true negative,TN)表示被正确分类为负类的样本数;假阴性(false negative,FN)表示被错误分类为负类的样本数。Pe的表达式如式(2)所示:

|

式中,I表示心理任务类别的总数(本研究中I = 2), 表示第i类心理任务的真实样本数,

表示第i类心理任务的真实样本数, 表示模型预测的第i类心理任务的样本数,N表示测试样本的总数。Acc、Pre、Rec和F1的取值范围均在[0, 1]之间。Kap是评估识别算法性能一致性的指标,其取值范围在[−1, 1]之间。上述5个评估指标的数值越接近于1,表示模型的分类性能越好。

表示模型预测的第i类心理任务的样本数,N表示测试样本的总数。Acc、Pre、Rec和F1的取值范围均在[0, 1]之间。Kap是评估识别算法性能一致性的指标,其取值范围在[−1, 1]之间。上述5个评估指标的数值越接近于1,表示模型的分类性能越好。

进一步地,本文还绘制了受试者工作特征曲线(receiver operator characteristic curve,ROC),来评估分类模型性能。ROC曲线结合了敏感性和特异性两个重要的性能度量指标。其中,敏感性也被称为真阳性率(true positive rate,TPR),指的是在所有实际为正类的样本中,被模型正确判断为正类的比例。敏感性越高,意味着模型越少漏报正类。特异性也称为真阴性率,它表示在所有为负类的样本中,被模型正确判断为负类的比例。特异性越高,意味着模型越少将负类误判为正类。ROC曲线通过绘制不同分类阈值下的TPR和假阳性率(false positive rate,FPR)之间的关系,来展示模型的性能。FPR的计算公式如式(3)所示:

|

第6个评估指标AUC值,指的是ROC曲线下的面积,其取值范围为[0, 1]之间。AUC值越趋近于1,则表明模型的分类性能越好。

2 试验

2.1 受试者和数据采集

本文共招募了8名健康受试者(2名男性和6名女性)参与试验,年龄为22 ~ 30周岁,平均年龄为(25.4 ± 2.0)岁,均为右利手。受试者均无任何神经、精神或脑部疾病史。试验开始前,受试者已被告知试验内容,并签署知情同意书。本研究中所有人体试验均已获得天津大学伦理委员会的批准(批文编号:TJUE-2024-010)。

fNIRS信号采集,使用实验室自主研发的便携式连续波扩散光学层析成像系统[28-29],系统实物图如图3所示。该系统包括10个光源对(由双波长的激光二极管组成)和4个光电倍增管探测器。同时,该系统采用锁相光子计数技术,实现了双波长(785、830 nm)下高灵敏度的全并行测量[28]。在本研究中,仅使用其中4个光源对和4个探测器,以形成一个单晶格布配方案,如图3所示。根据国际10-20标准导联系统,光源光纤和探测光纤通过自制的柔性头带布配在前额叶皮质区,并覆盖光极定位点FP1和FP2以采集fNIRS信号,源探距设置为30 mm。为了确保测量数据具有较高的信噪比,故将系统采样率设置为4 Hz。

图3

fNIRS信号的采集

Figure3.

Acquisition of fNIRS signal

图3

fNIRS信号的采集

Figure3.

Acquisition of fNIRS signal

2.2 试验方案

在记录fNIRS数据时,受试者应尽量避免头部移动,以减少由此产生的运动伪影干扰。同时,受试者需按照显示器上的指示,分别执行相应的MA或MS任务[9, 14]。在本研究中,试验范式的示意图如图4所示。每位受试者需在1 d内执行24次数据收集会话。每次数据收集会话,包括:30 s的试验前休息期(即基线期);然后是6个40 s的单试次(MA和MS任务交替进行),其中每个试次的前20 s为MA或MS任务;随后是20 s的休息期;最后是30 s的试验后休息期,如图4所示。所有受试者的数据收集工作应在一周内完成。本研究将单个试次作为样本,以实现对心理任务的精确解码。每位受试者在每类心理任务中采集了72个试次的数据。因此,每位受试者的试次总数为144个。故而,rIRN模型的预训练样本量为144 × 7 = 1 008个。

图4

试验范式

Figure4.

Experimental paradigm

图4

试验范式

Figure4.

Experimental paradigm

2.3 信号预处理

本文利用修正比尔—朗伯定律(modified Beer-Lambert law,MBLL)和数字带通滤波器,将系统测量的原始光强信号转换为滤波的氧合血红蛋白浓度变化(changes in oxy-hemoglobin concentration,∆[HbO])。然后,按照单试次的间隔将∆[HbO]数据进行分割,并将其存储为灰度图像的形式。最后,将读取的灰度图像归一化后,作为输入馈送到TL-rIRN模型。MBLL中的差分路径因子(differential pathlength factor,DPF)(以符号DPF表示),在双波长(785、830 nm)下设置为: 和

和 [30]。使用截止频率为0.018 Hz和0.300 Hz的五阶零相位巴特沃斯数字带通滤波器,以抑制原始∆[HbO]信号中的基线偏移和生理干扰[14, 31-32]。然后,使用三阶最小二乘平滑滤波器处理滤波后的∆[HbO]信号,以减轻高频迈耶波振荡(相对于血液动力学响应频率)和全局系统随机噪声对信号的干扰。针对受试者在每次数据收集会话中所获得的数据,本文将利用该次会话基线期的数据对其进行基线校正。变异系数(coefficient of variation,CV)(以符号CV表示)是一种常用于评估测量的原始光强数据质量的指标[9]。如果CV > 10%,则表明测量数据中存在较大的运动伪影,需要丢弃该次会话的数据并重新进行测量。

[30]。使用截止频率为0.018 Hz和0.300 Hz的五阶零相位巴特沃斯数字带通滤波器,以抑制原始∆[HbO]信号中的基线偏移和生理干扰[14, 31-32]。然后,使用三阶最小二乘平滑滤波器处理滤波后的∆[HbO]信号,以减轻高频迈耶波振荡(相对于血液动力学响应频率)和全局系统随机噪声对信号的干扰。针对受试者在每次数据收集会话中所获得的数据,本文将利用该次会话基线期的数据对其进行基线校正。变异系数(coefficient of variation,CV)(以符号CV表示)是一种常用于评估测量的原始光强数据质量的指标[9]。如果CV > 10%,则表明测量数据中存在较大的运动伪影,需要丢弃该次会话的数据并重新进行测量。

在LOSO-CV方法中,首先将目标受试者的∆[HbO]数据归一化到[0, 1],然后对数据进行随机洗牌。在将预训练模型迁移到目标受试者的数据集中时,目标受试者的每类心理任务的数据集按照10: 3: 5的比例分为训练集、验证集和测试集,以便用于TL-rIRN模型的微调迁移训练、超参数选择和性能测试。因此,对于每名目标受试者,本文将微调训练的最大样本量设定为80,验证集样本量为24,测试集样本量为40。

2.4 统计分析

本研究使用科学绘图和数学分析软件OriginPro 2023(OriginLab Inc.,美国)中的配对样本t检验(显著性水平设定为0.05),对不同识别算法的评估指标进行统计分析。同时,ROC曲线也用于评估不同识别算法的泛化性能。

3 结果

为了验证TL-rIRN方法在跨受试解码心理任务方面的有效性和优越性,本研究选取了fNIRS-BCI领域中其他4种常用的深度学习模型,包括IRN、2层卷积的CNN模型(CNN model with 2-layer convolution,CNN2L)[14]、6层卷积的CNN模型(CNN model with 6-layer convolution,CNN6L)[14],以及深度递归卷积神经网络(deep recurrent convolutional neural network,RCNN)[33],作为预训练模型进行对比实验。以上4种深度学习模型采用了与TL-rIRN相同的迁移学习策略,并形成了TL-IRN、TL-CNN2L、TL-CNN6L和TL-RCNN等深度迁移学习模型。这5种深度迁移学习模型在预训练和微调时的条件是相同的。为了更准确地评估识别算法的分类性能,本文使用了5次的LOSO-CV方法来计算评估指标的平均值。

3.1 分类性能对比

为了探究5种深度迁移学习方法在MA和MS数据集上的跨受试解码性能,在微调阶段,本文计算了在不同的每类训练样本量(Nt=4, 8, ···, 40)下的6个评估指标,定量对比结果如图5所示。结果显示,当不使用微调技术时(即Nt = 0时),5种深度迁移学习方法的分类性能表现相近,即评估指标的平均数值都较低,这表明它们无法有效区分新受试者的心理状态。进一步观察图5中的所有结果,可以发现随着Nt 的增大,5种深度迁移学习方法的跨受试解码性能也随之提高。这些结果证实了,微调技术对深度迁移学习方法在跨受试解码中的分类性能具有显著的增强作用。这些发现与预期一致,并表明选择更大的微调训练数据集,可有效提升深度迁移学习方法在跨受试解码中的分类性能。这一研究结果也进一步验证了迁移学习的有效性,并突显了深度迁移学习在同构性假设条件下的优势。

图5

不同深度迁移学习方法的性能对比

Figure5.

Performance comparison of different deep transfer learning methods

图5

不同深度迁移学习方法的性能对比

Figure5.

Performance comparison of different deep transfer learning methods

值得注意的是,在每个Nt值下,TL-rIRN方法在5种深度迁移学习方法中表现最佳,取得了最高的分类性能。相比之下,在对照方法中,TL-IRN方法表现最好,而TL-CNN2L方法则次之。从图5的平均Acc结果中还可看出,即使当Nt = 4时,TL-rIRN的平均Acc达到了(72.19 ± 1.98)%。与TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L相比,TL-rIRN的平均Acc分别提高了22.09%、29.93%、29.77%和34.31%。当Nt = 40时,TL-rIRN方法跨受试解码的平均Acc高达(89.81 ± 2.41)%。以上结果进一步证明了,所提TL-rIRN方法对跨受试解码性能具有显著的增强作用,并显示出其优越性。

根据图5中所设定的Nt值,本文从所有的微调训练数据集中等间隔地选取了4组数据集(即Nt = 4、16、28和40),并比较了5种深度迁移学习方法在这些数据集上的平均ROC曲线,结果如图6所示。结果显示,在4组不同的微调训练数据集下,TL-rIRN方法的平均ROC曲线均比对照方法更靠近左上角,这表明TL-rIRN方法具有更高的分类性能。此外,随着Nt的增大,TL-rIRN方法的平均ROC曲线变得更加陡峭(对应的AUC值更大),说明TL-rIRN方法在微调训练数据集增大时,具有更好的跨受试解码性能。同时,对照的深度迁移学习方法也呈现出相同的规律。综上分析,图5和图6的结果验证了TL-rIRN方法在跨受试解码性能方面的优越性,并表明该方法在受试者之间具有良好的泛化性能。

图6

不同深度迁移学习方法的平均ROC曲线对比分析

Figure6.

Comparative analysis of the averaged ROC curves of different deep transfer learning methods

图6

不同深度迁移学习方法的平均ROC曲线对比分析

Figure6.

Comparative analysis of the averaged ROC curves of different deep transfer learning methods

3.2 校准时间对比

为进一步验证TL-rIRN方法在减少校准时间方面的优势,本文对比了跨受试解码(TL-rIRN)与受试特定解码[rIRN、支持向量机(support vector machine,SVM)、线性判别分析(linear discriminant analysis,LDA)]的分类性能,实验结果如图7所示。rIRN算法的批量大小设置为4,max(Epo)设为100,其余参数设置与TL-rIRN方法的预训练模型保持一致。对于SVM算法,本文采用线性核函数作为映射函数,并将其正则化参数设定为1[2, 14];而LDA算法则采用标准的静态LDA分类器实现[9, 34]。另外,TL-rIRN的微调训练样本量与受试特定解码的训练样本量相同。实验结果显示,随着Nt值的增加,跨受试解码和受试特定解码的平均Acc都随之提高,并呈现出高度一致的趋势。然而,在每个Nt值下,跨受试解码所获得的平均Acc始终高于受试特定解码的平均Acc。这表明TL-rIRN方法中预训练模型成功学习到了受试者间神经激活的共同特征;同时,预训练模型经微调后能够很好地捕获到新受试者的大脑激活模式变化。相比之下,受试特定解码方法可能需要更多的训练数据,才能学习并适应受试者自身的激活模式特性。因此,在相同大小的训练数据集(所对应的校准时间相同)下,TL-rIRN方法取得了更高的分类性能。

图7

跨受试解码和受试特定解码的分类结果对比

图7

跨受试解码和受试特定解码的分类结果对比

*

*

图7中,红色虚框所对应的Nt值表示,实现平均Acc超过有效二分类BCI通信的阈值精度(70%)时,识别算法所需的最少每类训练样本量。跨受试解码TL-rIRN方法所需的 值仅为4个试次,远低于表现最佳的受试特定解码LDA算法所需的28个试次。此外,TL-rIRN所对应的校准时间,即采集2Nt个试次数据所需的时间,仅为5.33 min。相较之下,LDA的校准时间需要37.33 min,因此TL-rIRN在校准时间上节省了32.00 min的时间开销。同时,图7中的配对样本t检验结果表明,在所有的Nt值下,TL-rIRN与所有受试特定解码算法的分类性能差异具有统计学意义。另外,当与图5中取得最高平均Acc的对照深度迁移学习方法相比时(如TL-IRN,在其平均Acc ≥ 70%时所需的最小Nt值为16个,对应的校准时间为21.33 min),TL-rIRN方法也大大缩短了16.00 min的校准时长。综上,TL-rIRN确实显著减少了深度学习模型的校准时间,并提高了 BCI系统在实际应用中的通用性和实用性。

值仅为4个试次,远低于表现最佳的受试特定解码LDA算法所需的28个试次。此外,TL-rIRN所对应的校准时间,即采集2Nt个试次数据所需的时间,仅为5.33 min。相较之下,LDA的校准时间需要37.33 min,因此TL-rIRN在校准时间上节省了32.00 min的时间开销。同时,图7中的配对样本t检验结果表明,在所有的Nt值下,TL-rIRN与所有受试特定解码算法的分类性能差异具有统计学意义。另外,当与图5中取得最高平均Acc的对照深度迁移学习方法相比时(如TL-IRN,在其平均Acc ≥ 70%时所需的最小Nt值为16个,对应的校准时间为21.33 min),TL-rIRN方法也大大缩短了16.00 min的校准时长。综上,TL-rIRN确实显著减少了深度学习模型的校准时间,并提高了 BCI系统在实际应用中的通用性和实用性。

3.3 模型计算时间对比

上节研究结果表明,相较于受试特定解码方法,跨受试解码方法在新受试者上达到超过70%的分类精度时,所需的校准时间更短。此外,微调迁移模型是在预训练模型的基础上进行微调,相较于从头开始训练的受试特定解码方法,其所需的校准样本量和Epo数也较少。因此,TL-rIRN方法在缩短校准时间的同时,也显著降低了模型的训练时间和计算资源的消耗。

fNIRS-BCI系统在日常环境(如智能交互)和临床领域(如神经反馈和疾病诊疗)的应用中,迫切需求一种快速且高效的实时识别算法。因此,将TL-rIRN方法与滑动窗口技术相结合,可应用于实时解码大脑思维状态的跨受试研究[14]。为了评估TL-rIRN方法的实时分类性能,本文测量了该模型的训练和测试时间。针对MA和MS数据集,本文对比了5种深度迁移学习方法的GPU计算时间,包括预训练时间、微调训练时间和测试时间(均指平均时间),结果如表1所示。微调训练时间是在Nt = 20和max(Epo) = 50条件下计算得到的。结果显示,与对照方法相比,TL-rIRN方法的预训练时间和微调训练时间更长。这是因为rIRN模型的复杂度决定了其计算复杂度。然而,在fNIRS-BCI系统的实际应用中,研究者通常更关心微调训练时间,以便更快地将预训练模型迁移到目标受试者的数据集中。尽管TL-rIRN的微调训练时间分别是TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L的1.68倍、2.80倍、8.15倍和6.15倍,但其仍能较好地满足实际应用的需求,并获得优越的解码性能。在测试时间的对比中,TL-rIRN与对照方法之间的差异较小。同时,TL-rIRN可实时处理系统采样率约为26.3 Hz的fNIRS信号,这进一步验证了TL-rIRN方法在跨受试、实时解码应用中的可行性。

4 讨论

本文离线采集了8名受试者的MA和MS数据,深入探究了包括TL-rIRN、TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L等5种先进深度迁移学习方法,在不同训练样本量下跨受试解码性能的差异。进一步地,本文将所提TL-rIRN方法与其他深度迁移学习方法和受试特定解码方法在校准时间方面进行了详细的比较分析。此外,为了更全面理解各深度迁移学习方法的计算效率,本文还对比了它们的模型计算时间,涵盖预训练时间、微调训练时间以及测试时间等关键指标。

本文采用6个评估指标,全面评估了不同深度迁移学习方法的跨受试解码性能。研究结果表明,5种深度迁移学习方法的跨受试解码性能排序如下:TL-rIRN > TL-IRN > TL-CNN2L > TL-RCNN > TL-CNN6L。其中,与其他深度迁移学习方法相比,TL-rIRN对每类训练样本量表现出更高的敏感性。因此,在训练样本量不足时,TL-rIRN能够展现出更优越的跨受试解码性能。这一结果进一步证实,在达到相同的解码精度时,TL-rIRN具有显著缩短校准时间的优势;特别是与受试特定解码方法相比时,TL-rIRN在减少校准时间方面的优势尤为明显。

在本研究中,单试次的刺激间隔被设定为20 s。在实际应用中,若缩短刺激间隔,有望进一步缩短校准时间,从而提高fNIRS-BCI系统的实用性。此外,图7的实验结果显示,跨受试解码性能优于受试特定解码性能。这是因为,在相同训练样本量下,受试特定解码的深度学习算法和机器学习算法无法得到充分训练,导致其解码性能相对不足。然而,尽管TL-rIRN在跨受试解码性能方面表现出色,但其采用的先进时空特征提取模块,却导致其模型整体复杂度提升。这种复杂度的增加进而降低了模型的建模速度(对应预训练时间和微调训练时间)以及解码速度(对应测试时间)。尽管如此,TL-rIRN在实际应用中仍能满足跨受试、实时解码的需求。

在fNIRS-BCI系统的实际应用中,为提升用户体验和系统实用性,Kwon等[8]探索了无校准受试独立解码方法。该方法仅对深度学习模型进行预训练,无需使用目标受试者的数据对预训练模型进行微调。预训练模型具有一定泛化能力,可为有限样本的进一步监督学习提供有益知识。然而,本研究发现,受个体差异和生理噪声等因素影响,预训练模型在新受试者数据上的适应性仍有限,跨受试解码效果有待提升。因此,无校准受试者独立解码方法具有研究潜力,但仍需更多研究者深入研究以优化其性能。

综上,本研究虽然取得了不错的实验结果,但仍然具有一定局限性,均将逐步在未来工作中加以解决。本研究的局限性体现在:首先,本文仅验证了TL-rIRN方法在跨受试单试次识别中的可行性和有效性,未来本文将进一步探索该方法在跨受试、实时解码中的应用。其次,为了验证TL-rIRN方法的普适性,本文应考虑将更广泛的心理任务作为研究对象。这将有助于进一步拓展跨受试解码的应用范围,并提高所提方法的通用性和实用性。第三,本研究存在受试者例数较少和男女比例不均衡的问题。为确保相对同质性,本文将在未来研究中从更广泛的人群和不同年龄段中招募更多的受试者。第四,尽管表1中rIRN模型的预训练时间满足实际需求,但仍然较长。为缩短预训练时间,本研究需合理分配计算资源,避免资源竞争和不足问题。另外,本文还考虑使用专门的计算集群或云平台进行模型的训练,以提高性能和稳定性。最后,针对预训练模型未曾见过的任务数据,本文还应深入探究该模型的跨任务泛化性能,发展更为先进的迁移学习策略避免负迁移问题,并提高跨受试、跨任务的识别性能。

5 结论

为解决fNIRS-BCI领域中传统受试特定解码方法存在的校准耗时过长和跨受试泛化性低的问题,本文提出一种新颖的深度迁移学习方法—TL-rIRN,旨在实现跨受试高精度解码fNIRS信号。在6项评估指标中,本文TL-rIRN方法均展现出最优性能,证明了其跨受试解码的有效性和优越性。相较于其他深度迁移学习方法及受试特定解码方法,TL-rIRN大幅减少了校准时间。虽然,TL-rIRN建模速度较慢,但其解码速度仍满足在线fNIRS-BCI系统的实时性要求。因此,TL-rIRN不仅提高了跨受试解码的泛化性能,还缩短了校准时间,减少了目标模型的训练时间和计算资源的消耗。本文结论为跨受试、跨任务和实时解码算法的选择提供了理论依据和数据支撑,对于在日常生活、神经反馈训练以及临床应用中构建便捷通用型fNIRS-BCI系统具有潜在应用价值。

重要声明

利益冲突声明:本文全体作者均声明不存在利益冲突。

作者贡献声明:张耀负责创新研究、试验设计、程序实现、数据分析以及论文撰写和修改;刘东远负责数据采集和整理、技术支持以及论文校稿;高峰教授负责论文指导和修改。

伦理声明:本研究通过了天津大学伦理委员会的审批(批文编号:TJUE-2024-010)

0 引言

功能近红外光谱(functional near-infrared spectroscopy,fNIRS)是一种新型无创、实时、非电离、便携、低成本、低运动伪影和主动测量式的光学神经成像技术,具有合理的时空分辨率。与脑电图(electroencephalography,EEG)相比,fNIRS具备较高的空间分辨率和较强的环境鲁棒性[1-3]。与功能磁共振成像(functional magnetic resonance imaging,fMRI)相比,fNIRS具备较高的时间分辨率、较低的环境噪声干扰和优异的运动鲁棒性[4-5]。因此,fNIRS在无创脑-机接口(brain-computer interface,BCI)领域中得到了广泛应用。目前,fNIRS-BCI主要应用于脑控机器、神经康复、疾病诊疗和教育教学等诸多领域[3, 6-7]。近年来,fNIRS-BCI技术发展迅速并取得了显著进展,但其在实际应用中仍面临着重大挑战[1-2],这是因为fNIRS信号是时变非平稳信号,通常表现为受试内特异性较高、受试间变异性较强和重测信度较低[8-9]。fNIRS信号易受用户的认知负荷、跨试次认知疲劳和学习效应等因素影响,导致其在当天试验过程中会随时间发生改变[9]。因此,在使用fNIRS-BCI系统之前,用户通常需要进行一段较长时间的校准过程,以收集足够的数据来构建一个稳定且可靠的受试特定解码算法,从而精确识别自身行为和心理状态。然而,较长的校准过程会导致用户在使用fNIRS-BCI系统前就已感到疲劳,从而显著降低了BCI系统的实用性。此外,个体差异也会影响受试特定解码算法在不同受试间的泛化性能,进而降低其在实际应用时的可靠性和普适性。

传统的受试特定解码算法存在两个固有瓶颈,即校准时间过长和跨受试泛化性低。校准时间,是指建立和优化BCI系统性能所需的数据采集和处理时间,包括收集用户的大脑活动数据,并将其与特定的任务或意图进行匹配。通过校准,系统能够学习并识别与特定意图相关的大脑信号模式,以实现用户意图的准确解码和相应操作的执行。跨受试泛化性低,是指BCI系统在处理新用户数据时识别性能下降的现象。为克服这些问题,BCI研究者提出了跨受试解码方法(即受试独立解码),该方法已成为解决上述问题的关键技术,并成功提升了BCI系统的实用性和稳定性[8, 10-12]。跨受试解码是BCI研究中一个重要的领域[12-13],其旨在从多名受试的脑信号中提取受试间神经激活的共同特征,来构建一个通用的心理状态识别算法,从而可在新受试上实现神经激活模式的精确识别。

跨受试解码方法已被广泛应用于EEG-BCI和fMRI-BCI领域[10-12, 14-17],这也将在未来成为fNIRS-BCI研究的重要方向。在fMRI-BCI领域中,Raizada等[15]从神经激活的相似性角度出发,提出了神经相似性空间方法,用于解决跨受试解码问题。随着人工智能的快速发展,全数据驱动的深度学习识别算法作为自动特征提取器和分类器,而被广泛应用于神经信号解码中[18-20]。在EEG-BCI领域中,Kwon等[10]提出了一种基于深度卷积神经网络(convolutional neural network,CNN)的无校准受试独立解码方法,用于跨受试识别左、右手运动想象的EEG信号。受上述研究启发,Kwon等[8]也将CNN模型应用于无校准跨受试解码fNIRS信号中,以跨受试识别是在执行心算(mental arithmetic,MA)任务还是处于空闲状态。Kwon等[8]的研究证明了基于CNN模型的跨受试解码方法在fNIRS-BCI中的可行性。然而,该方法通过使用多名受试者数据来构建通用的CNN解码模型,该模型只能学习到受试间神经激活的共同特征,而无法习得目标受试者的个体特征。尽管无校准跨受试解码方法提高了fNIRS-BCI系统的通用性和实用性,但跨受试解码精度的提升仍受到限制。因此,使用少量目标受试者的数据对通用模型进行微调,是提高跨受试解码精度的关键步骤[8, 21]。在最新的fNIRS-BCI研究中,Khalil等[22]将基于同构对称特征的迁移学习应用于CNN中,来识别不同水平的心理负荷。然而,该方法局限性在于,它依赖于同构性假设,并且仅适用于同构任务,即任务之间的样本分布在特征空间中是相似的。在fNIRS-BCI的实际应用中,异构任务(即不同心理任务)的样本分布差异较大。此情况下,同构对称特征迁移学习无法有效地进行跨任务识别。此外,将CNN模型应用于fNIRS-BCI也存在一定的局限性。该模型并未针对fNIRS信号的时空特性进行结构性调整和设计。由于CNN模型仅使用小尺寸的滤波器提取局部特征,因此难以有效捕捉到大范围、多尺度和高阶的特征[14, 23-25]。

本研究致力于解决上述跨受试解码fNIRS信号所面临的挑战,旨在以最少量的校准数据最大程度地提升跨受试解码心理任务的准确率。为此,本文创新性地提出了一种深度迁移学习方法,以增强跨受试解码的性能。该方法融合了改进型启发式残差网络(revised inception-residual network,rIRN)与迁移学习(transfer learning,TL)策略,简称为TL-rIRN方法。其中,rIRN模型作为一种先进的深度学习算法,已显示出在fNIRS信号识别方面的显著优势[14];而基于模型的迁移学习策略,不仅适用于同构任务,更能有效应对跨任务解码的挑战。为了全面验证TL-rIRN方法在跨受试解码中的可行性和优越性,本研究将其与未经微调的预训练模型以及其他深度迁移学习方法进行深入对比分析。期望通过本文研究,提出的TL-rIRN方法能为fNIRS-BCI领域的跨受试解码研究提供全新的视角和解决方案。

1 方法

1.1 改进型启发式残差网络模型

rIRN模型是在启发式残差网络(inception-residual network,IRN)架构的基础上,针对fNIRS信号的复杂时空特性做了精心的结构性设计和调整,旨在精确识别大脑在不同任务下的激活状态[14]。该模型的整体架构如图1所示,详尽地展示了卷积滤波器的关键参数设置,包括滤波器数量(number of filters,NF)、滤波器尺寸(filter size,FS)以及卷积操作的步长(stride)。rIRN模型的输入层是多变量时间序列表示的fNIRS信号,即采样点数×采样通道数。

图1

rIRN模型的架构

Figure1.

The architecture of the rIRN model

图1

rIRN模型的架构

Figure1.

The architecture of the rIRN model

rIRN模型的架构主要由空间特征提取模块(feature extraction module,FEM)和时间FEM串联组成。其中,空间FEM由空间FEM-A和空间FEM-B两个子模块组成,而时间FEM则由时间FEM-A、时间FEM-B以及时间FEM-C三个子模块组成。每个FEM子模块均由IRN网络和降维网络构成。IRN网络采用不同尺寸的一维卷积滤波器(one-dimensional convolution filter,Conv),以提取fNIRS信号中不同尺度的时空特征,进而实现增强模型的特征表示能力。多尺度时空特征提取能在更大的范围内识别出重要模式和关联;还能捕捉稳定特征,增强研究结果的鲁棒性;并适应个体大脑结构与功能差异,从而精确揭示个体独特的大脑活动模式。同时,IRN网络中的残差连接不仅有助于提取全局特征,还能有效解决深度神经网络中梯度消失或梯度爆炸问题。

每个IRN网络后都配备了一个降维网络,旨在减少模型的计算量和参数量。全局最大池化层的应用则进一步对提取的时空特征进行降维,减少了特征数量,并有助于降低模型复杂度,提高泛化能力。为了防止过拟合,在rIRN模型的末端加入了一个随机失活层。经过随机失活层处理后的特征将被输送至全连接层(full connected layer,FCL),并最终输出至分类层,以对fNIRS信号进行类别预测。分类层采用归一化指数(softmax)函数实现分类概率的输出。该模型是一种普适性的多任务识别算法,可根据fNIRS信号的特点,自适应调整时空FS的大小,以提取多尺度的特征。

1.2 深度迁移学习

深度学习模型需要大量标注数据进行训练,因此在fNIRS信号中需要较长的校准时间,以收集足够的训练数据。获取大规模标注的fNIRS数据需耗费大量时间和资源,长时间的校准会导致受试者疲劳,从而影响数据质量。为在小样本数据集上训练深度学习模型,以实现跨受试解码心理任务,本文提出了一种新颖的深度迁移学习方法—TL-rIRN,其架构如图2所示。TL-rIRN方法主要包括两个步骤:预训练和微调。首先,使用多名受试者的数据(源域数据集)对rIRN模型进行预训练。随后,将预训练的rIRN模型迁移到目标受试者的数据(目标域数据集)中,并利用目标受试者的少量数据对预训练的rIRN模型进行微调。最终,得到适用于目标受试者的微调迁移模型,用于解码目标受试者的心理状态。

图2

TL-rIRN模型的架构

Figure2.

The architecture of the TL-rIRN model

图2

TL-rIRN模型的架构

Figure2.

The architecture of the TL-rIRN model

1.2.1 预训练

在图像识别领域,已有一些在图像网络(image network,ImageNet)数据集上预训练好的网络模型,如残差网络18(residual network 18,ResNet-18)和视觉几何组16(visual geometry group 16,VGG-16)等[26]。然而,在fNIRS-BCI领域,目前尚未存在可供直接迁移使用且基于大规模数据集预训练的模型。鉴于fNIRS信号具有空间特异性和记录参数的多样性,本研究需要收集充足的心理任务数据,以从头开始预训练rIRN模型。本文采用留一受试交叉验证(leave-one-subject-out cross validation,LOSO-CV)方法来评估TL-rIRN模型在fNIRS-BCI中跨受试解码的性能[27]。本文假设已采集了n名受试者的数据,并使用LOSO-CV方法进行交叉验证。在每次交叉验证中,本文将1名受试者的数据用于微调迁移模型的训练、验证和测试,而另外的n–1名受试者的数据则用于rIRN模型的预训练。然后本文重复这个过程,直到每名受试者的数据都被用作微调迁移模型的测试。预训练模型的超参数设置如下:批量大小为8;最大的迭代轮次(epoch,Epo)[以符号max(Epo)表示]为100;初始学习率为0.01;学习率衰减系数为0.1;学习率衰减周期为20个Epo;L2正则化因子为0.000 1;梯度下降优化算法为自适应矩估计算法。

1.2.2 微调

微调,通常指的是利用目标域数据集中有限的样本,对预训练的rIRN模型的浅层网络参数进行精细调整,并对替换的新层(如最后的FCL层和分类层)进行参数重新训练的过程。这一技术旨在提高模型对特定目标域数据集的适应性和性能。微调的理论基础主要建立在神经网络的迁移学习能力之上。经过迁移学习和微调后的模型,本文称之为微调迁移模型。该模型的结构由两部分组成:一部分是共享参数的迁移层,它通过使用预训练模型的参数作为其初始参数,实现了两模型之间的参数共享;另一部分是替换的新层,这些层的参数是通过微调过程重新训练的。

超参数选择在微调过程也扮演着重要的角色。本文根据目标域数据集的特点,选择合适的优化器、学习率、批量大小等超参数。在微调迁移模型的超参数调整过程中,初始学习率被设置为0.001。此值低于预训练模型的学习率,以有效减缓迁移层的学习速度。此外,本文对替换的FCL层的权重和偏置进行了设置,将其学习率因子设为10。该值高于预训练模型中默认的学习率因子1,能够加速新的最终层的学习速度。采用上述学习率的组合能够有效提高微调迁移模型的收敛速度和精度,对于迅速适应目标受试者的数据模式大有裨益。为避免微调过程中出现过拟合问题,通常将微调迁移模型的max(Epo)设置为少于预训练模型的数值[22]。这不仅可以有效解决过拟合问题,还能缩短微调迁移模型的训练时间。同时,本文还利用目标受试者的验证集来监控模型的性能,并根据需要调整超参数以获得最佳分类性能。另外,如果微调迁移模型的验证损失函数连续20次没有持续下降,训练会停止,以避免过拟合。

TL-rIRN模型是在计算机操作系统Windows 10(Microsoft Inc.,美国)上使用商业数学软件MATLAB R2022b(MathWorks Inc.,美国)构建的。该模型是在一台服务器上进行训练和测试,该服务器的配置如下:8条内存(DDR4 2666MHz 16.00 GB,Samsung Inc.,韩国)、2颗中央处理器(Xeon Gold

1.3 评估指标

本研究将MA任务作为正类,心唱(mental singing,MS)任务作为负类,并采用6个指标来定量评估所提TL-rIRN方法在跨受试解码中的分类性能。这些指标包括准确率(accuracy,Acc)、精确度(precision,Pre)、召回率(recall,Rec)、F1分数、卡帕系数(Kappa,Kap)以及曲线下面积(area under the curve,AUC)值。前5个指标均是通过混淆矩阵计算而来,其表达式如式(1)所示:

|

式中,真阳性(true positive,TP)表示被正确分类为正类的样本数;假阳性(false positive,FP)表示被错误分类为正类的样本数;真阴性(true negative,TN)表示被正确分类为负类的样本数;假阴性(false negative,FN)表示被错误分类为负类的样本数。Pe的表达式如式(2)所示:

|

式中,I表示心理任务类别的总数(本研究中I = 2), 表示第i类心理任务的真实样本数,

表示第i类心理任务的真实样本数, 表示模型预测的第i类心理任务的样本数,N表示测试样本的总数。Acc、Pre、Rec和F1的取值范围均在[0, 1]之间。Kap是评估识别算法性能一致性的指标,其取值范围在[−1, 1]之间。上述5个评估指标的数值越接近于1,表示模型的分类性能越好。

表示模型预测的第i类心理任务的样本数,N表示测试样本的总数。Acc、Pre、Rec和F1的取值范围均在[0, 1]之间。Kap是评估识别算法性能一致性的指标,其取值范围在[−1, 1]之间。上述5个评估指标的数值越接近于1,表示模型的分类性能越好。

进一步地,本文还绘制了受试者工作特征曲线(receiver operator characteristic curve,ROC),来评估分类模型性能。ROC曲线结合了敏感性和特异性两个重要的性能度量指标。其中,敏感性也被称为真阳性率(true positive rate,TPR),指的是在所有实际为正类的样本中,被模型正确判断为正类的比例。敏感性越高,意味着模型越少漏报正类。特异性也称为真阴性率,它表示在所有为负类的样本中,被模型正确判断为负类的比例。特异性越高,意味着模型越少将负类误判为正类。ROC曲线通过绘制不同分类阈值下的TPR和假阳性率(false positive rate,FPR)之间的关系,来展示模型的性能。FPR的计算公式如式(3)所示:

|

第6个评估指标AUC值,指的是ROC曲线下的面积,其取值范围为[0, 1]之间。AUC值越趋近于1,则表明模型的分类性能越好。

2 试验

2.1 受试者和数据采集

本文共招募了8名健康受试者(2名男性和6名女性)参与试验,年龄为22 ~ 30周岁,平均年龄为(25.4 ± 2.0)岁,均为右利手。受试者均无任何神经、精神或脑部疾病史。试验开始前,受试者已被告知试验内容,并签署知情同意书。本研究中所有人体试验均已获得天津大学伦理委员会的批准(批文编号:TJUE-2024-010)。

fNIRS信号采集,使用实验室自主研发的便携式连续波扩散光学层析成像系统[28-29],系统实物图如图3所示。该系统包括10个光源对(由双波长的激光二极管组成)和4个光电倍增管探测器。同时,该系统采用锁相光子计数技术,实现了双波长(785、830 nm)下高灵敏度的全并行测量[28]。在本研究中,仅使用其中4个光源对和4个探测器,以形成一个单晶格布配方案,如图3所示。根据国际10-20标准导联系统,光源光纤和探测光纤通过自制的柔性头带布配在前额叶皮质区,并覆盖光极定位点FP1和FP2以采集fNIRS信号,源探距设置为30 mm。为了确保测量数据具有较高的信噪比,故将系统采样率设置为4 Hz。

图3

fNIRS信号的采集

Figure3.

Acquisition of fNIRS signal

图3

fNIRS信号的采集

Figure3.

Acquisition of fNIRS signal

2.2 试验方案

在记录fNIRS数据时,受试者应尽量避免头部移动,以减少由此产生的运动伪影干扰。同时,受试者需按照显示器上的指示,分别执行相应的MA或MS任务[9, 14]。在本研究中,试验范式的示意图如图4所示。每位受试者需在1 d内执行24次数据收集会话。每次数据收集会话,包括:30 s的试验前休息期(即基线期);然后是6个40 s的单试次(MA和MS任务交替进行),其中每个试次的前20 s为MA或MS任务;随后是20 s的休息期;最后是30 s的试验后休息期,如图4所示。所有受试者的数据收集工作应在一周内完成。本研究将单个试次作为样本,以实现对心理任务的精确解码。每位受试者在每类心理任务中采集了72个试次的数据。因此,每位受试者的试次总数为144个。故而,rIRN模型的预训练样本量为144 × 7 = 1 008个。

图4

试验范式

Figure4.

Experimental paradigm

图4

试验范式

Figure4.

Experimental paradigm

2.3 信号预处理

本文利用修正比尔—朗伯定律(modified Beer-Lambert law,MBLL)和数字带通滤波器,将系统测量的原始光强信号转换为滤波的氧合血红蛋白浓度变化(changes in oxy-hemoglobin concentration,∆[HbO])。然后,按照单试次的间隔将∆[HbO]数据进行分割,并将其存储为灰度图像的形式。最后,将读取的灰度图像归一化后,作为输入馈送到TL-rIRN模型。MBLL中的差分路径因子(differential pathlength factor,DPF)(以符号DPF表示),在双波长(785、830 nm)下设置为: 和

和 [30]。使用截止频率为0.018 Hz和0.300 Hz的五阶零相位巴特沃斯数字带通滤波器,以抑制原始∆[HbO]信号中的基线偏移和生理干扰[14, 31-32]。然后,使用三阶最小二乘平滑滤波器处理滤波后的∆[HbO]信号,以减轻高频迈耶波振荡(相对于血液动力学响应频率)和全局系统随机噪声对信号的干扰。针对受试者在每次数据收集会话中所获得的数据,本文将利用该次会话基线期的数据对其进行基线校正。变异系数(coefficient of variation,CV)(以符号CV表示)是一种常用于评估测量的原始光强数据质量的指标[9]。如果CV > 10%,则表明测量数据中存在较大的运动伪影,需要丢弃该次会话的数据并重新进行测量。

[30]。使用截止频率为0.018 Hz和0.300 Hz的五阶零相位巴特沃斯数字带通滤波器,以抑制原始∆[HbO]信号中的基线偏移和生理干扰[14, 31-32]。然后,使用三阶最小二乘平滑滤波器处理滤波后的∆[HbO]信号,以减轻高频迈耶波振荡(相对于血液动力学响应频率)和全局系统随机噪声对信号的干扰。针对受试者在每次数据收集会话中所获得的数据,本文将利用该次会话基线期的数据对其进行基线校正。变异系数(coefficient of variation,CV)(以符号CV表示)是一种常用于评估测量的原始光强数据质量的指标[9]。如果CV > 10%,则表明测量数据中存在较大的运动伪影,需要丢弃该次会话的数据并重新进行测量。

在LOSO-CV方法中,首先将目标受试者的∆[HbO]数据归一化到[0, 1],然后对数据进行随机洗牌。在将预训练模型迁移到目标受试者的数据集中时,目标受试者的每类心理任务的数据集按照10: 3: 5的比例分为训练集、验证集和测试集,以便用于TL-rIRN模型的微调迁移训练、超参数选择和性能测试。因此,对于每名目标受试者,本文将微调训练的最大样本量设定为80,验证集样本量为24,测试集样本量为40。

2.4 统计分析

本研究使用科学绘图和数学分析软件OriginPro 2023(OriginLab Inc.,美国)中的配对样本t检验(显著性水平设定为0.05),对不同识别算法的评估指标进行统计分析。同时,ROC曲线也用于评估不同识别算法的泛化性能。

3 结果

为了验证TL-rIRN方法在跨受试解码心理任务方面的有效性和优越性,本研究选取了fNIRS-BCI领域中其他4种常用的深度学习模型,包括IRN、2层卷积的CNN模型(CNN model with 2-layer convolution,CNN2L)[14]、6层卷积的CNN模型(CNN model with 6-layer convolution,CNN6L)[14],以及深度递归卷积神经网络(deep recurrent convolutional neural network,RCNN)[33],作为预训练模型进行对比实验。以上4种深度学习模型采用了与TL-rIRN相同的迁移学习策略,并形成了TL-IRN、TL-CNN2L、TL-CNN6L和TL-RCNN等深度迁移学习模型。这5种深度迁移学习模型在预训练和微调时的条件是相同的。为了更准确地评估识别算法的分类性能,本文使用了5次的LOSO-CV方法来计算评估指标的平均值。

3.1 分类性能对比

为了探究5种深度迁移学习方法在MA和MS数据集上的跨受试解码性能,在微调阶段,本文计算了在不同的每类训练样本量(Nt=4, 8, ···, 40)下的6个评估指标,定量对比结果如图5所示。结果显示,当不使用微调技术时(即Nt = 0时),5种深度迁移学习方法的分类性能表现相近,即评估指标的平均数值都较低,这表明它们无法有效区分新受试者的心理状态。进一步观察图5中的所有结果,可以发现随着Nt 的增大,5种深度迁移学习方法的跨受试解码性能也随之提高。这些结果证实了,微调技术对深度迁移学习方法在跨受试解码中的分类性能具有显著的增强作用。这些发现与预期一致,并表明选择更大的微调训练数据集,可有效提升深度迁移学习方法在跨受试解码中的分类性能。这一研究结果也进一步验证了迁移学习的有效性,并突显了深度迁移学习在同构性假设条件下的优势。

图5

不同深度迁移学习方法的性能对比

Figure5.

Performance comparison of different deep transfer learning methods

图5

不同深度迁移学习方法的性能对比

Figure5.

Performance comparison of different deep transfer learning methods

值得注意的是,在每个Nt值下,TL-rIRN方法在5种深度迁移学习方法中表现最佳,取得了最高的分类性能。相比之下,在对照方法中,TL-IRN方法表现最好,而TL-CNN2L方法则次之。从图5的平均Acc结果中还可看出,即使当Nt = 4时,TL-rIRN的平均Acc达到了(72.19 ± 1.98)%。与TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L相比,TL-rIRN的平均Acc分别提高了22.09%、29.93%、29.77%和34.31%。当Nt = 40时,TL-rIRN方法跨受试解码的平均Acc高达(89.81 ± 2.41)%。以上结果进一步证明了,所提TL-rIRN方法对跨受试解码性能具有显著的增强作用,并显示出其优越性。

根据图5中所设定的Nt值,本文从所有的微调训练数据集中等间隔地选取了4组数据集(即Nt = 4、16、28和40),并比较了5种深度迁移学习方法在这些数据集上的平均ROC曲线,结果如图6所示。结果显示,在4组不同的微调训练数据集下,TL-rIRN方法的平均ROC曲线均比对照方法更靠近左上角,这表明TL-rIRN方法具有更高的分类性能。此外,随着Nt的增大,TL-rIRN方法的平均ROC曲线变得更加陡峭(对应的AUC值更大),说明TL-rIRN方法在微调训练数据集增大时,具有更好的跨受试解码性能。同时,对照的深度迁移学习方法也呈现出相同的规律。综上分析,图5和图6的结果验证了TL-rIRN方法在跨受试解码性能方面的优越性,并表明该方法在受试者之间具有良好的泛化性能。

图6

不同深度迁移学习方法的平均ROC曲线对比分析

Figure6.

Comparative analysis of the averaged ROC curves of different deep transfer learning methods

图6

不同深度迁移学习方法的平均ROC曲线对比分析

Figure6.

Comparative analysis of the averaged ROC curves of different deep transfer learning methods

3.2 校准时间对比

为进一步验证TL-rIRN方法在减少校准时间方面的优势,本文对比了跨受试解码(TL-rIRN)与受试特定解码[rIRN、支持向量机(support vector machine,SVM)、线性判别分析(linear discriminant analysis,LDA)]的分类性能,实验结果如图7所示。rIRN算法的批量大小设置为4,max(Epo)设为100,其余参数设置与TL-rIRN方法的预训练模型保持一致。对于SVM算法,本文采用线性核函数作为映射函数,并将其正则化参数设定为1[2, 14];而LDA算法则采用标准的静态LDA分类器实现[9, 34]。另外,TL-rIRN的微调训练样本量与受试特定解码的训练样本量相同。实验结果显示,随着Nt值的增加,跨受试解码和受试特定解码的平均Acc都随之提高,并呈现出高度一致的趋势。然而,在每个Nt值下,跨受试解码所获得的平均Acc始终高于受试特定解码的平均Acc。这表明TL-rIRN方法中预训练模型成功学习到了受试者间神经激活的共同特征;同时,预训练模型经微调后能够很好地捕获到新受试者的大脑激活模式变化。相比之下,受试特定解码方法可能需要更多的训练数据,才能学习并适应受试者自身的激活模式特性。因此,在相同大小的训练数据集(所对应的校准时间相同)下,TL-rIRN方法取得了更高的分类性能。

图7

跨受试解码和受试特定解码的分类结果对比

图7

跨受试解码和受试特定解码的分类结果对比

*

*

图7中,红色虚框所对应的Nt值表示,实现平均Acc超过有效二分类BCI通信的阈值精度(70%)时,识别算法所需的最少每类训练样本量。跨受试解码TL-rIRN方法所需的 值仅为4个试次,远低于表现最佳的受试特定解码LDA算法所需的28个试次。此外,TL-rIRN所对应的校准时间,即采集2Nt个试次数据所需的时间,仅为5.33 min。相较之下,LDA的校准时间需要37.33 min,因此TL-rIRN在校准时间上节省了32.00 min的时间开销。同时,图7中的配对样本t检验结果表明,在所有的Nt值下,TL-rIRN与所有受试特定解码算法的分类性能差异具有统计学意义。另外,当与图5中取得最高平均Acc的对照深度迁移学习方法相比时(如TL-IRN,在其平均Acc ≥ 70%时所需的最小Nt值为16个,对应的校准时间为21.33 min),TL-rIRN方法也大大缩短了16.00 min的校准时长。综上,TL-rIRN确实显著减少了深度学习模型的校准时间,并提高了 BCI系统在实际应用中的通用性和实用性。

值仅为4个试次,远低于表现最佳的受试特定解码LDA算法所需的28个试次。此外,TL-rIRN所对应的校准时间,即采集2Nt个试次数据所需的时间,仅为5.33 min。相较之下,LDA的校准时间需要37.33 min,因此TL-rIRN在校准时间上节省了32.00 min的时间开销。同时,图7中的配对样本t检验结果表明,在所有的Nt值下,TL-rIRN与所有受试特定解码算法的分类性能差异具有统计学意义。另外,当与图5中取得最高平均Acc的对照深度迁移学习方法相比时(如TL-IRN,在其平均Acc ≥ 70%时所需的最小Nt值为16个,对应的校准时间为21.33 min),TL-rIRN方法也大大缩短了16.00 min的校准时长。综上,TL-rIRN确实显著减少了深度学习模型的校准时间,并提高了 BCI系统在实际应用中的通用性和实用性。

3.3 模型计算时间对比

上节研究结果表明,相较于受试特定解码方法,跨受试解码方法在新受试者上达到超过70%的分类精度时,所需的校准时间更短。此外,微调迁移模型是在预训练模型的基础上进行微调,相较于从头开始训练的受试特定解码方法,其所需的校准样本量和Epo数也较少。因此,TL-rIRN方法在缩短校准时间的同时,也显著降低了模型的训练时间和计算资源的消耗。

fNIRS-BCI系统在日常环境(如智能交互)和临床领域(如神经反馈和疾病诊疗)的应用中,迫切需求一种快速且高效的实时识别算法。因此,将TL-rIRN方法与滑动窗口技术相结合,可应用于实时解码大脑思维状态的跨受试研究[14]。为了评估TL-rIRN方法的实时分类性能,本文测量了该模型的训练和测试时间。针对MA和MS数据集,本文对比了5种深度迁移学习方法的GPU计算时间,包括预训练时间、微调训练时间和测试时间(均指平均时间),结果如表1所示。微调训练时间是在Nt = 20和max(Epo) = 50条件下计算得到的。结果显示,与对照方法相比,TL-rIRN方法的预训练时间和微调训练时间更长。这是因为rIRN模型的复杂度决定了其计算复杂度。然而,在fNIRS-BCI系统的实际应用中,研究者通常更关心微调训练时间,以便更快地将预训练模型迁移到目标受试者的数据集中。尽管TL-rIRN的微调训练时间分别是TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L的1.68倍、2.80倍、8.15倍和6.15倍,但其仍能较好地满足实际应用的需求,并获得优越的解码性能。在测试时间的对比中,TL-rIRN与对照方法之间的差异较小。同时,TL-rIRN可实时处理系统采样率约为26.3 Hz的fNIRS信号,这进一步验证了TL-rIRN方法在跨受试、实时解码应用中的可行性。

4 讨论

本文离线采集了8名受试者的MA和MS数据,深入探究了包括TL-rIRN、TL-IRN、TL-RCNN、TL-CNN2L和TL-CNN6L等5种先进深度迁移学习方法,在不同训练样本量下跨受试解码性能的差异。进一步地,本文将所提TL-rIRN方法与其他深度迁移学习方法和受试特定解码方法在校准时间方面进行了详细的比较分析。此外,为了更全面理解各深度迁移学习方法的计算效率,本文还对比了它们的模型计算时间,涵盖预训练时间、微调训练时间以及测试时间等关键指标。

本文采用6个评估指标,全面评估了不同深度迁移学习方法的跨受试解码性能。研究结果表明,5种深度迁移学习方法的跨受试解码性能排序如下:TL-rIRN > TL-IRN > TL-CNN2L > TL-RCNN > TL-CNN6L。其中,与其他深度迁移学习方法相比,TL-rIRN对每类训练样本量表现出更高的敏感性。因此,在训练样本量不足时,TL-rIRN能够展现出更优越的跨受试解码性能。这一结果进一步证实,在达到相同的解码精度时,TL-rIRN具有显著缩短校准时间的优势;特别是与受试特定解码方法相比时,TL-rIRN在减少校准时间方面的优势尤为明显。

在本研究中,单试次的刺激间隔被设定为20 s。在实际应用中,若缩短刺激间隔,有望进一步缩短校准时间,从而提高fNIRS-BCI系统的实用性。此外,图7的实验结果显示,跨受试解码性能优于受试特定解码性能。这是因为,在相同训练样本量下,受试特定解码的深度学习算法和机器学习算法无法得到充分训练,导致其解码性能相对不足。然而,尽管TL-rIRN在跨受试解码性能方面表现出色,但其采用的先进时空特征提取模块,却导致其模型整体复杂度提升。这种复杂度的增加进而降低了模型的建模速度(对应预训练时间和微调训练时间)以及解码速度(对应测试时间)。尽管如此,TL-rIRN在实际应用中仍能满足跨受试、实时解码的需求。

在fNIRS-BCI系统的实际应用中,为提升用户体验和系统实用性,Kwon等[8]探索了无校准受试独立解码方法。该方法仅对深度学习模型进行预训练,无需使用目标受试者的数据对预训练模型进行微调。预训练模型具有一定泛化能力,可为有限样本的进一步监督学习提供有益知识。然而,本研究发现,受个体差异和生理噪声等因素影响,预训练模型在新受试者数据上的适应性仍有限,跨受试解码效果有待提升。因此,无校准受试者独立解码方法具有研究潜力,但仍需更多研究者深入研究以优化其性能。

综上,本研究虽然取得了不错的实验结果,但仍然具有一定局限性,均将逐步在未来工作中加以解决。本研究的局限性体现在:首先,本文仅验证了TL-rIRN方法在跨受试单试次识别中的可行性和有效性,未来本文将进一步探索该方法在跨受试、实时解码中的应用。其次,为了验证TL-rIRN方法的普适性,本文应考虑将更广泛的心理任务作为研究对象。这将有助于进一步拓展跨受试解码的应用范围,并提高所提方法的通用性和实用性。第三,本研究存在受试者例数较少和男女比例不均衡的问题。为确保相对同质性,本文将在未来研究中从更广泛的人群和不同年龄段中招募更多的受试者。第四,尽管表1中rIRN模型的预训练时间满足实际需求,但仍然较长。为缩短预训练时间,本研究需合理分配计算资源,避免资源竞争和不足问题。另外,本文还考虑使用专门的计算集群或云平台进行模型的训练,以提高性能和稳定性。最后,针对预训练模型未曾见过的任务数据,本文还应深入探究该模型的跨任务泛化性能,发展更为先进的迁移学习策略避免负迁移问题,并提高跨受试、跨任务的识别性能。

5 结论

为解决fNIRS-BCI领域中传统受试特定解码方法存在的校准耗时过长和跨受试泛化性低的问题,本文提出一种新颖的深度迁移学习方法—TL-rIRN,旨在实现跨受试高精度解码fNIRS信号。在6项评估指标中,本文TL-rIRN方法均展现出最优性能,证明了其跨受试解码的有效性和优越性。相较于其他深度迁移学习方法及受试特定解码方法,TL-rIRN大幅减少了校准时间。虽然,TL-rIRN建模速度较慢,但其解码速度仍满足在线fNIRS-BCI系统的实时性要求。因此,TL-rIRN不仅提高了跨受试解码的泛化性能,还缩短了校准时间,减少了目标模型的训练时间和计算资源的消耗。本文结论为跨受试、跨任务和实时解码算法的选择提供了理论依据和数据支撑,对于在日常生活、神经反馈训练以及临床应用中构建便捷通用型fNIRS-BCI系统具有潜在应用价值。

重要声明

利益冲突声明:本文全体作者均声明不存在利益冲突。

作者贡献声明:张耀负责创新研究、试验设计、程序实现、数据分析以及论文撰写和修改;刘东远负责数据采集和整理、技术支持以及论文校稿;高峰教授负责论文指导和修改。

伦理声明:本研究通过了天津大学伦理委员会的审批(批文编号:TJUE-2024-010)